Η χρήση των AI Chatbots οδηγεί στην παραβίαση των προσωπικών σας δεδομένων

Τον τελευταίο καιρό, η ολλανδική αρχή προστασίας δεδομένων AP λαμβάνει αρκετές γνωστοποιήσεις παραβιάσεων δεδομένων εξαιτίας της κοινολόγησης προσωπικών δεδομένων από εργαζομένους που χρησιμοποιούν chatbot με τεχνητή νοημοσύνη.

Εισάγοντας προσωπικά δεδομένα σε AI chatbots, οι εταιρείες που τα παρέχουν μπορεί να αποκτήσουν μη εξουσιοδοτημένη πρόσβαση στα δεδομένα αυτά.

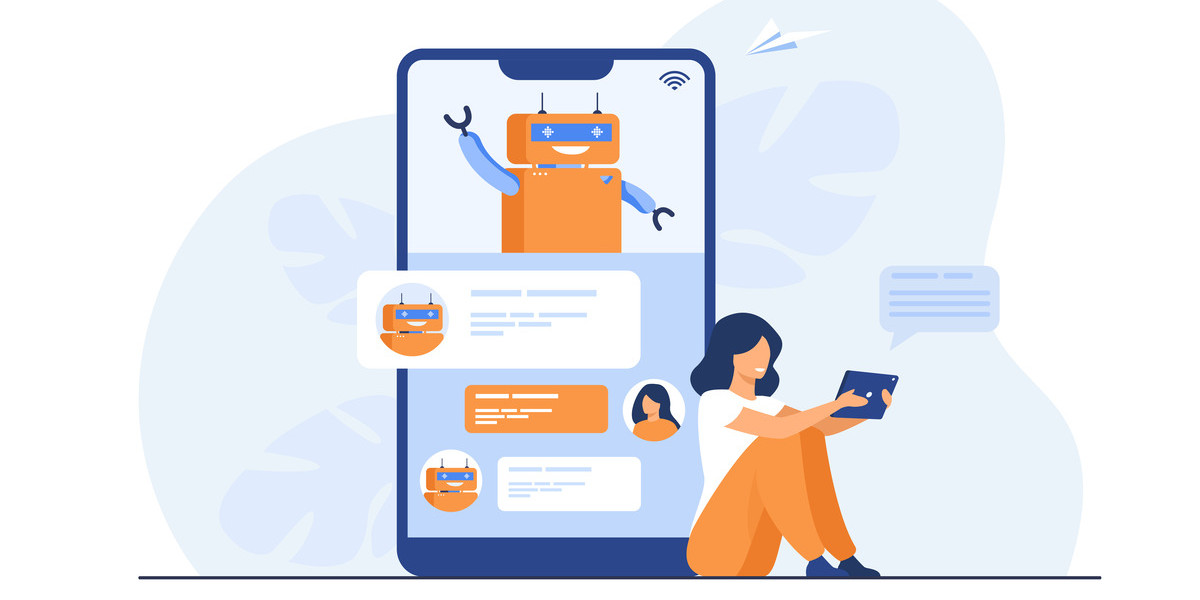

Η AP παρατηρεί πως είναι πολλοί εκείνοι που χρησιμοποιούν ψηφιακούς βοηθούς, όπως το ChatGPT και το Copilot στο εργασιακό περιβάλλον. Αυτό γίνεται, για παράδειγμα, προκειμένου να απαντηθούν ερωτήματα πελατών ή να συνοψιστούν μεγάλα αρχεία. Η πρακτική αυτή μπορεί να γλυτώσει χρόνο για τον εργαζόμενο και να τον απαλλάξει από μια όχι και τόσο ευχάριστη υποχρέωση, ωστόσο εμπεριέχει σημαντικούς κινδύνους.

Παραβίαση δεδομένων υπάρχει όταν κάποιος αποκτά πρόσβαση σε προσωπικά δεδομένα, χωρίς άδεια ή πρόθεση. Πολύ συχνά, οι εργαζόμενοι χρησιμοποιούν τα chatbots με δική τους πρωτοβουλία και παρά τις εντολές του εργοδότη τους: εάν στο πλαίσιο αυτό εισάγουν στο σύστημα προσωπικά δεδομένα, τότε θα πρόκειται για παραβίαση δεδομένων. Άλλες φορές, η χρήση των AI chatbots προβλέπεται στις πολιτικές του φορέα: στην περίπτωση αυτή δεν έχουμε παραβίαση δεδομένων, αλλά μια πρακτική αυτή που συχνά δεν είναι επιτρεπτή εκ του νόμου.

Οι φορείς πρέπει να αποφεύγουν και τις δύο περιπτώσεις.

Οι περισσότερες εταιρείες που βρίσκονται πίσω από τα chatbots αποθηκεύουν όλα τα δεδομένα που εισάγονται. Ως αποτέλεσμα αυτού, τα δεδομένα αυτά καταλήγουν στους servers των εταιρειών αυτών, συχνά χωρίς αυτό να είναι γνωστό στο πρόσωπο που τα εισήγαγε. Και χωρίς το πρόσωπο αυτό να γνωρίζει ποια θα είναι η χρήση των δεδομένων αυτών από την εταιρεία που τα έχει λάβει.

Έτι περαιτέρω, οι πληροφορίες αυτές δεν είναι γνωστές ούτε στο πρόσωπο που αφορούν τα δεδομένα αυτά.

Ιατρικά δεδομένα και διευθύνσεις πελατών

Σε μια από τις περιπτώσεις παραβίασης δεδομένων που γνωστοποιήθηκαν στην AP, ο υπάλληλος ενός ιατρείου εισήγαγε τα ιατρικά δεδομένα ασθενούς σε ένα AI chatbot, παρά τις αντίθετες οδηγίες του εργοδότη.

Τα ιατρικά δεδομένα είναι ιδιαίτερα ευαίσθητα και για τον λόγο αυτό χρειάζονται ιδιαίτερη προστασία. Ακόμη και μια απλή κοινολόγηση αυτών σε μια εταιρεία τεχνολογίας συνιστά μείζονα παραβίαση της ιδιωτικότητας των εμπλεκομένων προσώπων.

Σε μια άλλη περίπτωση, η AP έλαβε γνωστοποίηση παραβίασης από τηλεπικοινωνιακό πάροχο, υπάλληλος του οποίου είχε εισαγάγει αρχείο με διευθύνσεις συνδρομητών σε ένα AI chatbot.

Η σύνταξη δεσμευτικών κειμένων

Είναι σημαντικό οι φορείς να δεσμεύουν τους υπαλλήλους τους ως προς τη χρήση AΙ chatbots.

Επιτρέπεται η χρήση τους από το προσωπικό ή πρέπει να αποφεύγεται;

Στην περίπτωση όπου οι εργοδότες το επιτρέπουν, πρέπει να καθιστούν σαφές στους εργαζόμενους το ποια δεδομένα μπορούν να εισάγουν και ποια όχι. Περαιτέρω, οι φορείς θα μπορούσαν να συμφωνούν με τον πάροχο του chatbot για τη μη αποθήκευση των δεδομένων που εισάγονται.

Η γνωστοποίηση της διαρροής δεδομένων

Κάτι πήγε λάθος και τα προσωπικά δεδομένα διέρρευσαν από έναν υπάλληλο μέσω της χρήσης chatbot, παρά τις σχετικές οδηγίες που του είχαν δοθεί;

Στην περίπτωση αυτή, η ανακοίνωση προς τα υποκείμενα των δεδομένων και η γνωστοποίηση στην εποπτική αρχή θα είναι, πολύ συχνά, υποχρεωτική.

Πηγή: https://www.lawspot.gr/